Auf Anregung von Besuchern meiner Homepage habe ich die Links für die Abbildungen in allen Lehrheften verändert:

Beim Aufrufen einer Abbildung öffnen Sie ein neues Fenster mit dem ausgewählten Bild. Um zur Textseite zurückzukehren müssen Sie dieses zweite Fenster entweder schließen oder zur Seite ziehen. Falls Sie die zweite Möglichkeit benutzen, wird das erste Bild beim erneuten Aufruf einer weiteren Abbildung überschrieben u.s.w.. Mit den Befehlen „vor“ und „zurück“ im aktuellen Bildfenster können die anderen, schon ausgewählten Abbildungen immer wieder aufgerufen werden. Rückkehr zur Textseite ist durch Anklicken dieser immer möglich.

Raumklang / Klangraum

Sehraum, Tastraum, Hörraum.

Vergleichen wir diese drei Räume, so müssen wir leider erkennen, dass der Hörraum die schlechteste räumliche Übersicht vermittelt.

Raumrelationen sind nur in geringem Maße wahrzunehmen.

Die Raumorientierung ist ausschließlich auf den eigenen Körper bezogen. Ausnahme: Der „Dopplereffekt“1 erlaubt die Tiefengliederung eines sich in Bewegung befindlichen akustischen Signals.

Ein schnelles Erfassen einer natürlichen Raumtiefe, der Raumgeometrie ist nur mit Hilfe des Sehsinns möglich.

Energieverlust und Ausbreitungsart der Schallwellen begrenzen den natürlichen Klangraum für die Musik.

Die Geschichte des Raumproblems ist geprägt von unterschiedlichen Begriffen und widersprüchlichen Aussagen, vor allem philosophischen Auseinandersetzungen.

Zusammenfassend: Unser natürlicher Hörraum ist bedingt raumvermittelnd, er ermöglicht eine ungenaue Schätzung der Entfernung, die Wahrnehmung von Bewegungen und die Lokalisierung der Raumrichtung von Hördaten.

Ich möchte nochmals betonen, dass diese Aussagen sich ausschließlich auf das Erfassen der Raumtiefe, auf Raumrelationen beziehen.

Wenn man bedenkt, wie groß der Dynamikbereich unseres Ohres ist, vom äußersten Pianissimo bis zum größten Fortissimo, und diesen Dynamikumfang mit anderen Sinnesorganen vergleicht, so ist das Ohr nach wie vor eines der sensibelsten, vor allem im Vergleich mit dem Sehsinn. In der Praxis heißt dies für uns, dass z. B. Lichtsteuerungen mittels akustischen Signalen sehr begrenzt sind. Die kontinuierlichen Helligkeitsstufen von dunkel bis hell entsprechen ungefähr einer musikalischen Lautstärke von pianissimo bis mezzoforte. Schon 1972 haben wir in Donaueschingen die Komposition „Dékollage, Musik zu Light Sound - Sound Light von Peter Sedgley“ von York Höller für zwei Sprechchöre und Instrumente uraufgeführt. Zweifellos waren die damaligen technischen Voraussetzungen noch schlecht, doch der fehlende Dynamikbereich des Lichts machte eine Realisation der Lichtsteuerung durch Musik nur bedingt möglich. Ab ca. mezzoforte war die Grenze der Lichthelligkeit erreicht.

„Die physikalische Akustik, Gehörpsychologie und Gehörphysiologie sind die Grundlagen einer globalen Betrachtung eines Klangraums. Die Philosophie spielt für die folgende Arbeit nur eine untergeordnete Rolle.

Die musikalische Akustik ist ein Teilgebiet der Akustik, das alle mit der Musik in Zusammenhang stehenden Fragen umfasst. Das Hauptinteresse der Akustik im musikalischen Bereich liegt auf der physikalischen Funktionsweise und der Klangstruktur der mechanischen Musikinstrumente sowie den Möglichkeiten elektronischer Klangerzeugung und -veränderung.

Hinzu kommt - und dies ist vor allem für meine Ausführungen wichtig - die Beeinflussung des musikalischen Klangbildes durch den umgebenden Raum. Die hochentwickelten Verfahren der elektronischen Klangerzeugung und -umwandlung stellen den Musiker vor entscheidende Fragen nach den ästhetischen Grenzen im weiten Felde der technischen Möglichkeiten.

Die richtungsabhängige Schallabstrahlung und die Mitwirkung des Raumes an dem Gehörseindruck eines Zuhörers sind schließlich Komponenten, die einen nicht unerheblichen Einfluss auf die Aufführungspraxis der Musik haben2.“

Als Ergänzung zum Textauszug von Jürgen Meyer möchte ich auf sein Buch hinweisen: „Akustik und musikalische Aufführunspraxis“, Verlag: Das Musikinstrument, Bd 24, Frankfurt a. M., 1972.

Nachstehend einige Merkmale der musikalischen, psychologischen und physiologischen Akustik, die unser Hören beeinflussen. Diese Hörkriterien sollte ein Komponist bei der akustischen Erfassung eines Klangraums, vor allem bei der Realisation einer Klangbewegung beachten. Im Folgenden werde ich versuchen, diese Merkmale im Einzelnen zu erarbeiten:

1. Die Phase, Phasenverschiebung.

2. Klangdynamik (Lautstärke), Nachhall und Widerhall, Klangquellenentfernung in einem geschlossenen Raum (Konzertsaal).

3. Klangbewegung.

4. Gehörpsychologische und -physiologische Probleme, z. B. Hören in der Medianebene - Horizontalebene oder Tonhöhen bezogenes Richtungshören.

Die innerhalb der einzelnen Sparten verwendete Literatur hat für meine Betrachtungen leider nur indirekte Gültigkeit. Die Ergebnisse der modernen physikalischen und psychophysikalischen Messmethoden, bezogen auf die Wahrnehmung von Hörereignissen, haben ein großes Objektivitätsmaß3 erreicht.

Leider sind jedoch diese großartigen Resultate wissenschaftlicher Forschung für die Arbeit des Praktikers, also uns Musikern, nur wenig anwendbar. Diese Ergebnisse wurden fast ausschließlich mit speziellen Messtönen in einem ungestörten Schallfeld, d. h. in schallarmen oder schalltoten Räumen durchgeführt. Und trotzdem ist diese wissenschaftliche Literatur Grundlage meiner Arbeit. Sie hat mir immer wieder Impulse und Anregungen gegeben, den Versuch zu unternehmen, ihre Erkenntnisse in die praktische musikalische Klangraumgestaltung einzuarbeiten. Die Ursache vieler Fehler in meinen teilweise rein empirischen Versuchen konnten durch sie rasche Klärung finden. Mit wenigen physikalischen und psychophysikalischen Aussagen möchte ich neue Möglichkeiten simulierter Klangräume und die dabei auftretenden gravierenden Unregelmäßigkeiten aufzeigen.

Luigi Nono sagte einmal: „Es gibt keine schlechten Konzertsäle, wir müssen nur versuchen, diese kennen zu lernen, d. h. ihre natürliche Akustik genau zu studieren und danach unsere neuen elektroakustischen Klangräume zu gestalten.“

Diese Aussage bedeutet, dass wir für eine Komposition einen neuen Klangraum mittels der Live-Elektronik auskomponieren und im Studioexperiment festlegen können, diesen Entwurf jedoch von Aufführungsort zu Aufführungsort neu überarbeiten, modifizieren müssen. Es ist für mich persönlich immer schwierig, bei der Vorbereitung zur Edition von Nonos Werken mit Elektronischer Klangumformung absolute Kriterien für den Klangraum festzulegen, da Nono und auch ich selbst diese von Konzert zu Konzert immer modifiziert haben. Gerade dieser Prozess des Erlernens und Modifizierens macht jedoch die Live-Elektronik, den Einsatz neuer, simulierter Klangräume zu einem lebendigen Instrument. Natürlich setzt diese Arbeitsweise voraus, dass der Konzertveranstalter den Interpreten auch

entsprechende Probezeiten einräumt, leider eines der größten Probleme unserer heutigen Aufführungspraxis. Ich werde am Ende dieses Lehrheftes nochmals auf dieses Thema zurückkommen.

„Die Phase ist eine physikalische Kenngröße, durch die der Schwingungszustand einer Schwingung zu jedem Zeitpunkt und bei einer Welle zu jedem Zeitpunkt und an jedem Ort bestimmt ist“4 .

Zur Erinnerung und einem besseren Verständnis zeige ich in Abbildung 1 nochmals eine Zeichnung aus dem ersten Band meiner Dokumentation über das Experimentalstudio der Heinrich-Strobel-Stiftung des Südwestfunks. Es handelt sich um eine periodische Schwingung, eine Sinusschwingung.

Abbildung 1

Das Pendel (oberer Teil der Zeichnung) führt eine Schwingung aus, die in der Physik nach der mathematischen Funktion Sinus/Cosinus eine Sinusschwingung genannt wird. Zieht man unter einem an der Pendelspitze befestigten Schreibstift während der Pendelbewegung einen Papierstreifen durch, dann erhält man eine Sinuskurve (Mittelteil Abbildung 1).

Für unsere Betrachtung ist vor allem der untere Teil interessant. In diesem Abschnitt der Zeichnung wird die Sinuskurve als Kreisfunktion dargestellt, ihre Geschwindigkeit (Frequenz) ist von der Pendelbewegung abhängig. In diesem Kreis können wir zu jedem Zeitpunkt der Sinusschwingung den Phasenwinkel f (Phi) ablesen.

Der Phasenwinkel einer Schwingung ist für die Musik nur dann von hörbarer Bedeutung, wenn:

1. ein akustisches Signal gleichzeitig zweimal über einen Kanal eingespielt wird .

2. ein akustisches Signal original und gleichzeitig „elektronisch umgewandelt“ über einen Kanal eingespielt wird.

3. ein Signal getrennt über zwei Lautsprecher wiedergegeben wird.

4. ein Signal original gehört und gleichzeitig bei gleicher Lautstärke über einen Lautsprecher eingespielt wird.

5. zwei gleiche Instrumental- oder Vokalstimmen, sehr nahe beieinander stehend (sitzend), unisono spielen oder singen (Intonation).

6. ein akustisches Signal original gehört und gleichzeitig über mehrere Lautsprecher eingespielt wird.

7. ein akustisches Signal original gehört und gleichzeitig eine Klangbewegung dieses Signals über mehrere Lautsprecher erfolgt.

Messtechnisch, d.h. rein physikalisch gibt es natürlich noch mehr Kombinationen, deren Zusammenwirken von der Phasenlage abhängig ist. In dieser Schrift geht es mir vor allem um die Beeinflussung der Phasenlage, des Phasenwinkels auf das klangliche Ergebnis einer Instrumental- oder Vokalkomposition in Verbindung mit Elektronischer Klangumformung, einer Klangraum-Komposition. Dabei ist dieses Ergebnis abhängig von der Art des akustischen Signals, seiner klanglichen Zusammensetzung. Wenn ich in den Abbildungen 2, 3 und 4 Beispiele mit einer Sinusschwingung zeige, so unterscheidet sich die klangliche Beeinflussung eines komplexen Signals darin, dass sich bei einem obertonreichen Klang die Lage des Phasenwinkels auf die einzelnen Teiltöne und damit auf die Klangfarbe verschieden auswirkt. Über die Möglichkeit der Entstehung von Summen- und Kombinationstönen verweise ich auf den ersten Band meiner Dokumentation.5 kmh * 1000 / 3600= m/sek.

Abbildung 2 zeigt zwei phasengleiche (Phasenwinkel = 0) Sinusschwingungen, man spricht in diesem Fall von kohärenten Signalen:

Abbildung 2

Zwei kohärente Signale addieren sich logarithmisch . Es verändert sich somit die Amplitude, dagegen bleibt die Klangfarbe gleich. In Abbildung 3 sind die beiden Sinusschwingungen ca. 90 Grad phasenversetzt.

Abbildung 3

Ergebnis nach „Mischung“: Abbildung 4: die Dynamik des Signals wird kleiner. Nichtkohärente Signale addieren sich um 3 dB wenige. Die Klangfarbe bleibt gleich. Ich betone nochmals: dieser physikalische Vorgang bezieht sich nur auf eine Wiedergabe von zwei Signalen über einen Lautsprecher.

Abbildung 4

Wenn wir die Phase zwischen den beiden Signalen um 180 Grad verschieben,

werden die beiden vollkommen ausgelöscht. Die Phasenverschiebungsbeispiele (Sinusschwingungen) wurden durch Verzögerung eines Kanals erreicht, beide Schwingungen sind konstant. Außerdem treffen diese Ergebnisse nur bei nicht räumlich-akustischen Informationen zu. Wie schon erwähnt, werden bei der Zusammenmischung „komplexer“ Signale die Phasenlagen der einzelnen Teiltöne unterschiedlich gegeneinander verschoben, wobei es je nach Größe der Verschiebung zu unterschiedlichen Dynamikveränderungen innerhalb der Teiltöne kommt und damit zu Klangfarbenveränderungen. Die Betrachtung der Schwingungsdauer 1/f (1/Frequenz) der Teiltöne macht dies besonders deutlich: Verzögert man eine Klangquelle, 1. Teilton (Grundton) gleich 65 Hz / Schwingungsdauer gleich 15,3 ms, gegenüber dem Original um 7,65 ms, dann würde die Phasenverschiebung von 1800 den Grundton C auslöschen. Besonders wirkt sich dieser Vorgang bei einer Klangbewegung aus. Ich werde darauf nochmals zurückkommen.

Ein anderes Ergebnis einer Phasenverschiebung erreichen wir durch eine Tonhöhenveränderung (Frequenz) einer der beiden Sinusschwingungen zwischen 1 und ca 14 Hz. Wir kennen diesen Vorgang als Schwebung. In Abbildung 5 habe ich versucht, das in diesem Beispiel entstehende „Wandern“ der tonhöhen- versetzten Sinusschwingung und die daraus entstehende Phasenlagenveränderung darzustellen. Bei höheren Frequenzen als ca. 14 Hz hören wir zuerst eine „rauhe Zone“, danach gehen die zwei Töne in Intervalle über.

Abbildung 5

Die Ergebnisse dieser Beispiele sind natürlich auch mit einem Originalton und einem umgewandelten (Selektion,Transformation) Originalton zu erreichen. Man sollte jedoch genau über die klangliche Zusammensetzung (Spektrum) des umgeformten Signals Kenntnis haben; nur so kann ein ungefähres Klangergebnis voraussehbar werden. Besonders zu beachten ist dabei, dass meist schon allein durch die Elektronische Klangumwandlung eine Phasenverschiebung entsteht. So ist es z. B. interessant, wenn bei einer kleinen Tonhöhentransposition (Mikrointervall) einer Vokalstimme diese nicht als Schwebung, sondern als Klangschärfe, vergleiche „rauhe Zone“, wahrgenommen wird. Ich denke dabei an Luigi Nonos „Atmendes Klarsein“, wo dieses Klangergebnis durch Mikrointervall Transposition der Frauenstimmen zustande kommt. Außerdem ist nochmals zu bemerken, dass alle Klangergebnisse bei räumlichen Signalen immer von mehreren Faktoren, wie z. B. Nachhall oder anderen Klangreflexionen abhängig sind.

Eine persönliche Anmerkung: Während meiner früheren Tätigkeit als Aufnahmeleiter in der Musikabteilung des Südwestfunks Baden-Baden musste ich immer wieder feststellen, dass die Phasenverschiebung durch kleine Tonhöhenunterschiede auch bei Instrumental- oder Vokalstimmen, die eng nebeneinander saßen oder standen und unisono musizierten, manchmal sehr störend wirkte. Natürlich kann man sagen, dass dies meist auf eine schlechte Intonation zurückzuführen war, doch ist z. B. schon das Tonhöhenvibrato bei zwei Violinen ein konstantes Phasenproblem. Auch ein „reiner“ Chorklang kann nur ohne Stimmtremolo der Sänger erreicht werden. Es muss dazu bemerkt werden, dass diese eben genannten Probleme meist bei Studioaufnahmen auftreten, während in einem Konzertsaal, je nach Nachhall, diese Phasenverschiebung im Raumklang mehr nivelliert wird.

Wird ein akustisches Signal über 2 Lautsprecher getrennt wiedergegeben, so ist die Auswirkung der Phasenlage eine andere. Bei gleicher Lautstärke wird ein Signal genau in der Mitte zwischen den Lautsprechern geortet. Wir kennen diesen und die nächsten akustischen Vorgänge aus der Stereophonie.

Klangbeispiel 1

Wenn die Abstände zwischen den beiden Lautsprechern und dem Zuhörer einem gleichschenkligen Dreieck entsprechen, dann sind die Laufzeiten der beiden Signale gleich. Alle folgenden räumlichen Hörereignisse sind immer auf diesen Standort des Hörers bezogen, eine der zu Beginn genannten Schwachstellen des räumlichen Hörens. Wenn ich nun die Lautstärke eines Kanals verändere, so wird die virtuelle Klangquelle in Richtung dieses oder von diesem weg sich bewegen. In der Praxis erleben wir dies bei einem dynamischen Abgleich der Lautsprecher in einem Aufführungsraum. Zuhause ist es als einfaches Verfahren zur Justierung einer Stereoanlage sehr nützlich. Wohlgemerkt, die Abstände zwischen den Lautsprechern und dem Hörer müssen immer gleich sein.

Wenn ich nun die Phase eines Kanals ein wenig verschiebe, ca. 1 bis 20 ms, dann ist innerhalb einer räumlichen Akustik noch keine Signalverzögerung (Echoeffekt) zwischen den beiden Lautsprechern wahrzunehmen. Aber das akustische Signal wird aufgrund der Laufzeitunterschiede, bei gleicher Dynamik, von unserem Hörsinn nicht mehr in der Mitte, sondern über die gesamte Basis der beiden Schallquellen geortet, das Klangbild ist verbreitert..

Klangbeispiel 2

Die Dauer der Verzögerung und damit die Phasenverschiebung ist natürlich von der jeweiligen Raumakustik abhängig und muss entsprechend modifiziert werden. Wir sehen, alle diese Raumklangeffekte müssen von Aufführung zu Aufführung neu erhört und gestaltet werden und sind für die Musik nicht nach einer starren Formel realisierbar. Um das klangliche Ergebnis besser zu hören, habe ich in meinem Klangbeispiel absichtlich die Phase zwischen 0 und 10 ms umgeschaltet.

Ein vollkommen diffuses Klangbild entsteht durch eine Phasenverschiebung von 180º zwischen den Kanälen. Unser Gehör empfindet dieses Klangergebnis unter Umständen „auf die Ohren drückend“. Da sich die Phasenverschiebung auf die einzelnen Teiltöne unterschiedlich auswirkt, können durch eine genaue Definition der Phasenverschiebung im Verhältnis zu den Teiltönen eines komplexen Klanges sehr interessante räumliche Klangwirkungen erzielt werden.

Klangbeispiel 3

Ich erinnere mich noch gut an die Anfangszeit der Stereophonie. Viele monorale Tonaufnahmen versuchte man durch Phasenverschiebung „räumlich“ aufzupolieren, eine Pseudostereophonie. Diese Stereoaufnahmen waren leicht zu entlarven. Schaltete man den Wiedergabeverstärker auf „Mono“, dann brach der Gesamt-klang dynamisch und klanglich deutlich zusammen.

Die Vergrößerung der Ortungsschärfe durch Phasenverschiebung kann - wie schon gesagt - bei Verwendung von mehreren Lautsprechern, bei Klangbewegungen sehr nützlich sein. Dies wird vor allem dann erforderlich, wenn originale Tonquellen wie Instrumente oder Singstimmen die verstärkten, umgewandelten oder bewegten akustischen Signale aus den Lautsprechern verwischen, deren Ortung erschweren.

Was heißt Hall?

Es gibt mehrere, teils sehr unterschiedliche Hallbegriffe:

1. Halligkeit: bedeutet neben dem Direktschall vorhandene reflektierte Schallwellen, die jedoch nicht als Wiederholung eines akustischen Signals (Direktschall) empfunden werden.

Beispiel: ein großer Saal, in dem der Schallquellenort sehr weit von einem Hörer entfernt ist. Die Sprachverständlichkeit ist schlecht, ebenfalls die Durchsichtigkeit eines differenzierten Klangbildes (z. B. polyphone Musik). Beides wird mit einer Annäherung des Hörers an die Schallquelle besser, unter Umständen klingt der Raum nahe der Schallquelle trocken.

2. Hallradius.

3. Raumschall: Gegensatz zum Direktschall. Summe der Schallwellen in einem geschlossenen Raum, die bis zum Eintreffen an einem Hörort mehrfach reflektiert wurden.

4. Nachhall: Nachhallwiederholte Reflexionen der Schallwellen in einem geschlossenen Raum, die nach dem Abbrechen eines akustischen Signals allmählich und von mehreren Faktoren abhängig ausklingen, so z. B. von der Beschaffenheit der umgebenden Wandoberflächen. Im Gegensatz zum Direktschall entsteht ein statisches (diffuses) Schallfeld. Über Nachhallformen, Nachhallkurven und Nachhalldauer vergleiche Reallexikon der Akustik6.

5. Echo: Bezeichnung für Widerhall, das sind Schallreflexionen, die nicht als ein kontinuierlich abklingender akustischer Vorgang gehört werden, sondern als räumlich und zeitlich getrennte Hörereignisse. Das Echo tritt normalerweise im Freien auf als einmalige Schallreflexion, z. B. an großen Gebäuden, Bergen etc..

Innerhalb der Elektronischen Klangumformung sind für einen kompositorischen Einsatz nur Nachhall, Hallradius und Echo interessant. Wie schon zu Anfang gesagt, begrenzen Energieverlust und Ausbreitungsart der Schallwellen den natürlichen Raumklang für die Musik. Die Elektronische Klangumformung ermöglicht nun die gezielte Schaffung von neuen Klangräumen, von neuen musikalischen Formen.

Normalerweise arbeiten wir mit einem Nachhall von 0,5 bis 9 Sekunden

Nachhalldauer. Ich denke an trockene Studioräume bis hin zur großen Kirchenakustik. Prinzipiell kann man sagen: je größer der Nachhall, umso diffuser ist das Klangbild einer Schallquelle. Wichtig für einen Musiker ist dabei das Verhältnis zwischen der direkten und der Summe der reflektierten Schallenergie, der Raumschallenergie. An einem bestimmten Hörort eines Konzertraums z.B. hören wir meist gleichzeitig den direkten und den reflektierten Klang einer Schallquelle. Der dynamische Unterschied der beiden akustischen Signale wird als „Hallabstand“ bezeichnet. Es folgt ein Klangbeispiel in dem das Verhältnis Direktschall / Nachhall kontinuierlich verändert wird.

Klangbeispiel 4

Sind beide Schallpegel gleich, bezeichnen wir diesen klanglichen Zustand als „Hallradius“. Der Hallradius steigt an, wenn das gesamte Raumvolumen größer wird. Er ist außerdem von der Tonhöhe und der Nachhallzeit abhängig.

Bewegt sich nun der Hörer, so wird je nach dessen Bewegungsrichtung die Größe des Hallabstands verändert. Das Verhältnis dieser Veränderung ist logarithmisch. In der Praxis heißt dies: entferne ich mich von der Schallquelle, dann wird das Klangbild des Direktschalls diffuser oder umgekehrt, es wird schärfer.

Abbildung 6

Mit dem Hallabstand werden wir uns noch im Abschnitt „Entfernungshören“ intensiver beschäftigen. Im Augenblick ist festzuhalten, dass das Verhältnis des Direktschalls zum Raumschall sehr davon abhängig ist, ob ich nur einen „trockenen“ Konzertraum etwas halliger machen möchte, oder aber der Nachhall für eine kompositorische Raumklangfunktion innerhalb der Elektronischen Klangumwandlung, wie z. B. Klangnähe oder Klangferne, eingesetzt wird.

Luigi Nono entwickelte für seinen Prometeo den "CORO LONTANISSIMO", Chorklang aus sehr großer Entfernung. Das Werk Nonos beginnt mit einem gesunge-nen Akkord des Chores (Frauenchor), der langsam aus dem Raum in einen neuen diffusen Raum wandert (zwischen 8 bis 15 Sekunden). Noch deutlicher wird dieser neue „Klangraum“ durch eine zusätzliche Transposition des Nachhalls um einen Tritonus nach unten. Der Chor singt fünffaches Pianissimo, in einer normalen Raumakustik ist selbst in einem noch so halligen Konzertsaal aufgrund der gerin-gen Schallenergie ein Nachhall dieser Zeitdauer nicht möglich. Zwei Klanggestal-ten, durch deren Mischung schon am Anfang einer großen Komposition die geo-metrischen Raumgrenzen verschwommen werden.

Abbildung 7

Nono verwendete seine neue musikalische Form auch im 2. Satz seines Prometeo, Isola una (Abb. 8). Für diesen Teil hat er die Nachhallzeit für CORO LONTANISSIMO auf 20 Sekunden verlängert, denn die Dynamik ist dreifaches Pianissimo. Auch in diesem Fall würde man ohne die Live-Elektronik nahezu keinen Nachhall hören, da die Intensität des Originalklanges zu klein ist. CORO LONTANISSIMO ist somit eine neue musikalische Form, die nur mit Hilfe der Elektronischen Klangumformung realisiert werden kann.

Abbildung 8

Die Digitaltechnik ermöglicht Nachhallzeiten, die mit natürlichen Schallreflexionen nichts zu tun haben: Zeiten zwischen 100 Millisekunden und 200 Sekunden und ein Raumvolumen bis zu einer Million Kubikmeter, wobei das Einsetzen der Reflexionen und ihre zeitlichen und spektralen Abklingfunktionen definiert werden können. Die Bezeichnung Nachhall ist nur noch bedingt gültig, es handelt sich mehr um neue künstliche "Klangräume". Sie sind als solche in die Elektronische Klangumformung einzuordnen. Es geht nicht mehr um die "Verhallung" von Klängen wie in der Produktionstechnik, vor allem aus dem Bereich der U-Musik bekannt, es geht um die Schaffung neuer Klangräume. Auf diesem Gedanken basierend werden die langen Nachhalldauern wieder sinnvoll. Natürlich müssen dafür auch neue kompositorische Formen erarbeitet werden.

Der Komponist schafft kraft seiner künstlerischen Aussage für seine Komposition einen eigenen künstlichen Klangraum, wobei wichtig ist, dass dieser Klangraum für jede neue Komposition, für jedes Konzert aufgrund der unterschiedlichen akustischen Bedingungen neu erforscht, neu bestimmt werden muß. Komponisten und Interpreten müssen sich immer wieder in den Klangraum einhören, hineinhören, den Raum verstehen lernen.

Die geometrischen Grenzen eines Raumes sind gegeben. Der Komponist versucht, in diesen Grenzen einen erhörbaren Klangraum zu schaffen, der diesen Grenzen entsprechen kann – er muß es nicht.

Vergleichen wir hierzu nochmal Nonos „Coro Lontanissimo“.

Die heutigen Konzerträume haben meist eine geringe klangliche Raumtiefe, ein Trend, der zweifellos auf die Studiotechnik der Medien: Rundfunk, Fernsehen und

Schallplatte zurückzuführen ist. Diese Medien verlangen ein Hören ohne Sehraum. Alle Instrumente oder Stimmen müssen präsent mit nahezu gleicher Intensität zu hören sein. Sollte dieses Klangverhältnis nicht stimmen, wird mit baulichen Maßnahmen, Schallreflektoren nachgeholfen. Man betrachte die neuen Konzertsäle wie z. B. den Kammersaal der Berliner Philharmonie oder den großen Konzertsaal in Gasteig (München), um nur zwei zu nennen, wo Schwärme von Reflektoren drohend über den Interpreten und Zuhörern schweben, die den Blick auf den eigentlichen Raum stören, ja teilweise verhindern. Damit wird ein künstlicher Raum für die traditionelle musikalische Aufführungspraxis geschaffen. Eine natürliche akustische Tiefenwirkung, wie sie für die neue und auch für die traditionelle Musik wünschenswert erscheint, wird durch diese Direktbeschallung meist nivelliert. Die Arbeit mit dem digitalen Nachhall, dem Hallradius und auch dem Echo versucht mittels der Elektronischen Klangerweiterung dem Komponisten den Klangraum in seiner großen Vielfalt und Tiefe als kompositorisches Material wiederzugeben.

Ein Paradoxon unserer heutigen Raumakustik.

Dieser kleine Exkurs in die heutige Aufführungspraxis soll verdeutlichen, wie wichtig es ist, gerade den digitalen Nachhall auch in Verbindung mit Klangtransposition und -selektion, sinnvoll in den kompositorischen Prozeß zu integrieren, d.h. neue künstliche Klangräume zu schaffen. Zu diesen Klangräumen gehört vor allem auch eine neue Klangraumtiefe - ich sagte es schon - eine Überwindung der geometrischen Grenzen des Raumes.

Wenn nun der Zeitunterschied zwischen dem Direktschall und dem Nachhall < 50 Millisekunden ist, dann werden der Direktschall als Primärsignal und das reflektierte Signal als getrennte Hörereignisse empfunden. Wir sprechen dann von einem „Echo“. Dieses Echo sollte normalerweise in einem Konzertraum nicht auftreten. Es ist von seiner architektonischen Umgebung abhängig, wir kennen es leider meist als ein störendes Flatterecho, das nur durch bauliche Maßnahmen beseitigt werden kann. Nun können wir aber auch künstlich mittels der Elektronischen Klangumwandlung, Klangsteuerung ein in einen kompositorischen Prozess integriertes Echo schaffen, das weitgehend von der räumlichen Situation unabhängig ist, dessen Schallrichtung(-en) die Lautsprecherpositionen bestimmen. Wir sehen, die Festlegung der endgültigen Form dieses Echos ist wiederum nur während der Probenarbeit im Konzertsaal möglich. Elektronische Echos sind dann musikalisch besonders interessant, wenn ein akustisches Signal nicht nur verzögert wiedergegeben wird, sondern dieses klanglich, z.B. durch Selektion oder Transposition verändert wird7 Anläßlich eines Besuches im Mai 1977 bei John Chowning, Stanford University S. Francisco, lernte ich die Klangwegsberechnungen für seine Komposition Turenas kennen. Ich war sehr beeindruckt und auch fasziniert, mit welcher Genauigkeit die Bewegungen nicht nur berechnet und programmiert, sondern auch gehört werden konnten. Natürlich saß man in einem kleinen Raum bei gleichem Abstand zu den 4 Lautsprechern auf dem Idealpunkt, was unter normalen Bedingungen im Konzertsaal nur für wenige Zuhörer möglich ist. Außerdem verwendet Chowning ausschließlich den Computer, d.h. synthetische Klangstrukturen. Ungeachtet dessen war dieser Besuch für mich und meine weitere Arbeit sehr wertvoll. Ich lernte, dass für einen Klangweg die dynamische Steuerung allein nicht immer ausreichend ist. Schon zu Beginn meiner Ausführungen zum Thema Klangraum habe ich auf die Hörprobleme in Beziehung der Erfassung einer Raumtiefe hingewiesen. Nun habe ich bei Chowning vor allem kennengelernt, dass der schon beschriebene Hallradius, der Hallabstand und die Klangselektion wichtige Funktionen für die elektronische Realisation von Klangraumtiefe sind. In Abbildungen 9 und 10 versuche ich nochmals, graphisch das Verhältnis zwischen Direktschall und Nachhall bei einer Klangbewegung darzustellen. Das Diagramm 9 zeigt einen Klangweg, der sich vom Hörer entfernt (von links nach rechts). Die Zeitfunktion ist absichtlich vernachlässigt, da die Größe von Faktor 1 (Hallradius)) relativ und die Raumakustik, das Raumvolumen in diesem Beispiel unbekannt sind. Das Ohr kann - wie schon an anderer Stelle gesagt - nur mangelhaft die Entfernung einer Schallquelle erfassen, um so wichtiger sind dynamische und klangliche Veränderungen eines simuliert ankommenden oder sich entfernenden Klanges (10).

Abbildung 9Abbildung 10

Wird ein akustisches Signal über mehrere Lautsprecher bewegt, dann kann mit der Simulation des Doppler-Effekts auch innerhalb der Elektronischen Klangsteuerung ein beachtliches Maß an neuer Klangraumgestaltung beigetragen werden. In Fußnote eins habe ich schon auf die Herkunft des Namens dieses akustischen Vorgangs hingewiesen: Christian Doppler, österreichischer Physiker. Wir erleben nahezu täglich im Straßenverkehr dieses Klangphänomen. Fährt z. B. ein Krankenwagen an uns vorbei, dann empfinden wir die Tonhöhe seiner Sirene auf der ankommenden Seite höher als auf der sich entfernenden . Ursache dieser Tonhöhenveränderung ist: Aufgrund der Eigengeschwindigkeit des Fahrzeugs werden die Schallwellen des sich nähernden Wagens komprimiert, der Klang der Sirene wird höher. Im Augenblick des Vorbeifahrens sinkt die Tonhöhe wieder auf Normal zurück. Mit dem Entfernen des Wagens werden die auf uns eintreffenden Schallwellen der Sirene wieder aufgrund der Eigengeschwindigkeit der „Schallquelle“ gedehnt, die Tonhöhe der Sirene wird tiefer. Doppler hat diesen Effekt wie folgt beschrieben:

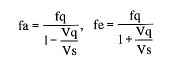

Frequenzen (Tonhöhen) der

fa = sich annähernde Schallquelle (Beispiel Krankenwagen)

fe = sich entfernende Schallquelle

fq = Schallquelle

Vs = Schallgeschwindigkeit = 344 m/Sek.

Vq = Geschwindigkeit der Schallquelle (Beispiel Krankenwagen)

Nehmen wir an, dass:

fq = 1000 Hz (< c3), Vs = 344 mISek und Vq = 15 km/h (ca. 4.16 m/Sek.) sind, dann wird die Tonhöhe fq der ankommenden Tonquelle um ca. 12 Hz höher, die der sich entfernenden um ca. 12 Hz tiefer sein.

Wie wir aus der Formel und dem Beispiel erkennen können, ist der Doppler-Effekt nur bei einer sich bewegenden Schallquelle wirksam, und damit sind wir schon mitten im nächsten Abschnitt „Klangbewegung“.

Beginn der Klangbewegungsversuche im Freiburger Experimentalstudio war Peter Lawos Entwicklung eines Gates, das ist ein Verstärker, dessen Funktion durch Anlegen einer Gleich- oder Wechselspannung kontrolliert wird, Vorgänger des gleichspannungs-kontrollierten Reglers für Regietische. Klangsteuerung in der Elektronischen Klangumformung bedeutet weder Transformation noch Selektion einer Tonquelle. Sie kann für beide eine kontrollierende Funktion übernehmen, hat jedoch auf die direkte Erweiterung eines Klangspektrums keinen Einfluß. Klangsteuerung heißt - wie der Name aussagt - Steuerung von Klanginformationen

jeglicher Art, von Instrumenten oder Stimmen, original oder elektronisch bearbeitet. Für mich war diese elektronische Regeltechnik von Anfang an faszinierend, vor allem durch den Austausch der Steuerkennlinien: linear - logarithmisch, linear invertiert - logarithmisch invertiert.

Abbildung 11

Der nächste Schritt war eine erste Klangbewegung mittels zwei durch eine Mikro-fonspannung gesteuerten Gates.

Abbildung 12

Durch Einbeziehung von Filter (Klangselektion), Harmonizer (Klangtransposition) und Nachhall habe ich versucht, den Weg zu Lautsprecher 2 aus den architektonischen Grenzen des Raumes in einen neuen Klangraum hinauszuführen.

Abbildung 13

In Klangbeispiel 5 hören wir die Erweiterung der Klangtiefe mittels Filter und Veränderung des Hallabstandes. Die Schritte bewegen sich akustisch durch zwei Räume.

Klangbeispiel 5

Eine wichtige Zwischenbemerkung: Die Abbildungen technischer Schaltungen sind Prinzipschaltungen, d. h., sie sind nicht an eine bestimmte Technik gebunden und können digital, hybrid oder analog realisiert werden. Es wäre müßig zu fragen, was heute das beste technische Verfahren ist. Die Systeme ändern sich von Monat zu Monat, von Jahr zu Jahr und was heute aktuell ist morgen schon veraltet.

Bei den Bewegungsversuchen mit Gateschaltungen ist wichtig, dass die Funktionen durch unterschiedliche Steuerspannungen, Daten, Gleich- oder Wechselspannungen, kontrolliert werden können, um damit dem Komponisten die Möglichkeit zu geben, die Steuerungsfunktion schon in seinen kompositorischen Entwurf einzuarbeiten. Gerade für die Klang-, Dynamik- oder Bewegungssteuerung mittels einer Mikrofonspannung muss der Komponist und Interpret nicht nur auf das direkt hörbare Ergebnis achten, sondern auch die gleichzeitige Funktion der Steuerung wiederum hörbar kontrollieren. Dies setzt vor allem einen neuen, zusätzlichen Umgang mit dem Mikrofon voraus, für viele Musiker eine schwierige Umstellung in der Ausführung ihrer persönlichen Interpretation. Abbildung 14 zeigt eine Partiturseite des „Diario polacco“ von Luigi Nono. Der Komponist hat für die beiden Sängerinnen genau ihre Bewegungen vor dem Mikrofon eingetragen. Die mit „MODULA“ bezeichnete Stimme steuert die Räumlichkeit der 1. Stimme über Lautsprecher. Aufgrund der Bewegungen vor dem Mikrofon erreicht Nono bei konstant gesungener Dynamik der Sängerinnen sehr unterschiedliche Steuerspannungen und die daraus resultierenden Raumeffekte.

Abbildung 14

Aus diesen Gateversuchen heraus entwickelte Dipl. Ing. Peter Lawo umd ich ein Gerät, das Klangbewegungen über mehrere Kanäle realisieren konnte. In Abbildung 15 sehen wir das damalige Schaltbild, reduziert auf 4 Kanäle. Die Steuerspannungen können entweder über vorgegebene Hüllkurvengeneratoren oder aber durch selbst gestaltete Steuerkurven ausgewählt werden. Die Ablaufgeschwindigkeit (Time-code) ist ebenfalls am Gerät einstellbar, kann jedoch auch über externe Spannungen, wie bei den Gates beschrieben, gesteuert werden. Die Form der Bewegung wird durch die Zuordnung der Lautsprecher erreicht: Wenn ich z. B. einen Klavierakkord anschlage, ihn über Mikrofon in den Raumklangverteiler einspiele und mit seiner Lautstärke gleichzeitig das Bewegungstempo kontrolliere, dann wird eine Bewegung mit dem Abklingen des originalen Klavierklanges immer langsamer bis zum Stillstand. Dadurch erreiche ich eine vollkommene Synthese zwischen Originalklang und dem Bewegungstempo des aufgenommenen und über Lautsprecher bewegten Klanges. Abbildung 15 zeigt das Prinzipschaltbild dieses universalen Raumklangsteuergerätes. Wie aus der Abbildung erkennbar ist, handelt es sich bei diesem Gerät um eine zweidimensionale Dynamiksteuerung. Zweifellos gibt es auch die Möglichkeit, jeden Ort des wandernden akustischen Signals dreidimensional zu bestimmen. Um die ganze Wirkung dieser Steuerung auch wahrnehmen zu können, muss der Zuhörer im Mittelpunkt eines Klangweges sitzen, was praktisch im Konzert nicht möglich ist. Außerdem ist der technische Aufwand sehr groß und steht in keinem Verhältnis zum klanglichen Ergebnis. Sicherlich wird die Digitaltechnik eines Tages auch die dreidimensionale Steuerung eines Klangweges mit weniger Aufwand ermöglichen.

Abbildung 15

Eine ebenfalls mit diesem Gerät, ich nenne es im Folgenden „HALAPHON“ (HAllerLAwo), gut zu realisierende akustische Funktion der Elektronischen Klangumwandlung ist die Simulation eines Dopplereffekts. Ich zeige zuerst eine Abbildung

der Hüllkurven. Sollte sich der Klang in einem Konzertsaal von vorne nach hinten bewegen, dann würden 4 Lautsprecher, von vorne nach hinten positioniert, benötigt. Man könnte z. B. diesen akustischen Vorgang auch in einem Raum rundum fortschreiten lassen, wobei Lautsprecher 4 gleichzeitig wieder der erste Lautsprecher des nächsten Ablaufs wäre. Ingesamt müssten für diese Bewegung ( 4 Doppler-Effekte) 12 Lautsprecher, im Konzertraum kreisförmig verteilt, zur Verfügung stehen.

Abbildung 16

In dieser Abbildung fehlen die Ein- und Ausklingfunktion bei Lautsprecher 1 und 4. Sie können je nach Integration in einem Gesamtablauf gestaltet werden. Die Programmsteuerung des Halaphons für einen Durchgang würde dann wie folgt aussehen:

Abbildung 17

Die Tonhöhenunterschiede (Harmonizer) können mit der Formel, siehe Seite 13, errechnet werden. Auch die Ablaufgeschwindigkeit ist leicht festzulegen. Für eine angenommene Geschwindigkeit der Schallquelle von ca. 15 km/h und einer Saallänge von ca. 12 m würde die Zeit einer Hüllkurve 2 Sekunden und damit die Zeitdauer von L 1 nach L 4 = 3 Sekunden betragen. Die Umrechnung km/h in m/ sek ist sehr leicht:

Als nächstes Beispiel habe ich einen kleinen Klangweg vorbereitet, der sehr einfach mit 4 Lautsprechern zu realisieren ist. Man könnte natürlich mit einer Veränderung der Hüllkurven und zusätzlicher Einbindung eines Klangumwandlers, vergleiche hierzu Abbildung 13, den Bewegungskreis noch vielseitiger gestalten. In Abbildung 18 ist die Ablauffunktion dargestellt:

Abbildung 18

Man beachte die Farben, die Bewegungslinien und ihre Zeitdauer und vergleiche diese mit den hierfür eingesetzten Hüllkurven für die Halaphonsteuerung. Auch bei diesem Beispiel handelt es sich um eine einfache Dynamiksteuerung in hybrider Technik. Der Klangweg beginnt bei Lautsprecher eins, wandert von diesem in 6

Sekunden nach Lautsprecher zwei. In Lautsprecher zwei bleibt das Signal vier Sekunden statisch. Danach geht es in einer Sekunde zu Lautsprecher drei, wo es wieder 6 Sekunden statisch stehen bleibt, um dann über Lautsprecher vier (3 Sekunden) nach Lautsprecher eins in 2 Sekunden zurückzukehren.

Abbildung 19

In Abbildung 19 sind die einzelnen Hüllkurven und ihre Zeitfunktion dargestellt. Ein Vergleich mit den Farben der Weglinien in Abbildung 18 macht die Zusammenhänge deutlich.

Für meine Arbeit mit Komponisten im Experimentalstudio der Heinrich-Strobel-Stiftung war es immer von großer Wichtigkeit, dass die Bedienung unseres Halaphons über eine auch für Nichttechniker oder Nichtinformatiker übersehbare Bedienungsplattform möglich war. Dies bezog sich vor allem auf folgende Eingabefunktionen:

1. Form und Zeit der Hüllkurven.

2. Zuordnung einer Hüllkurve zu einem der 16 Kanäle.

3. Startzeit der einzelnen Hüllkurven, Festlegung des Ablaufs der Hüllkurven: punktförmig oder überlappend. Die Blendzeiten zwischen den Hüllkurven müssen z.T. von der Grundzeit (1.) der Hüllkurve abgezogen werden.

4. Einstellung der Zeitfunktion für den time code, automatisch oder extern kontrolliert, d. h., interne oder externe Kontrolle des Zählers.

5. Auslösung der Startfunktion: automatischer Programmablauf, manuell oder durch Trigger.

6. Zuordnung der einzelnen Kanäle zu den Lautsprechern (Bewegungsform).

Diese Funktionen sollten schnell verändert werden können, ihre Werte müssen auf einer Bedienungsplattform „sichtbar“ sein, damit eine Korrektur auch in einem konzertanten Ablauf möglich ist und eventuelle Ausfälle schnell behoben werden können. Für mich handelt es sich bei einem Halaphon nicht um eine technische Maschine, sondern um ein Instrument, das „spielbar“ sein muss. Dazu gehört auch eine entsprechende Vorbereitung, ein „Üben“. Und hier leidet leider unsere heutige Aufführungspraxis, denn: Zeit ist Geld, sagen die Veranstalter und denken weniger an künstlerische Verantwortung. Für eine Aufführung seines Prometeo hat Luigi Nono mindestens 3 Wochen Vorbereitung im Konzertsaal verlangt, vor allem auch wegen der schwierigen baulichen Veränderungen. In einer vorbereitenden Phase wurde die Akustik des Konzertraumes genau geprüft und danach die BasisKonzeption entworfen:

Abbildung 20

Abbildung 20 zeigt den Entwurf für die Aufteilung der 4 Orchester und der Instrumental- und Gesangssolisten. Eingetragen sind ebenfalls die Standorte der zwei Dirigenten sowie der Lautsprecherpositionen und vorgesehenen Klangwege. Aufgrund dieses Entwurfs konnte auch der Veranstalter unsere baulichen Wünsche rechtzeitig vorbereiten, sodass für die musikalische Probenphase möglichst viel Zeit zur Verfügung stand.

Warum dieser Aufwand?

Weder Musiker, noch Dirigent können sich bei zu kurzen Probezeiten mit der unterschiedlichen Akustik der einzelnen Konzerträume vertraut machen und die jeweiligen Klangräume studieren. Wenn dies nicht möglich, ist es der Interpret, der musizierende Mensch, der langsam zum reinen Routinier, zum Automaten wird, eine Denkweise, die vom maschinellen Denken nicht weit entfernt ist.

Luigi Nono war nicht nur ein Wegbereiter für eine neue, auch alte Musikpraxis, er versuchte immer wieder die Persönlichkeit des Interpreten zu stärken, zu festigen, indem er auch für den Musiker ein Kennenlernen seiner akustischen Umwelt verlangte. Zitat Nonos vor einer Aufführung seiner Komposition „Atmendes Klarsein“:

„...nicht allein der transformierte Klang als einzig wahrnehmbares Phänomen, sondern der lebendig-natürliche Klang des Chores und der Baßflöte und, im selben Augenblick, nicht in zeitlicher Abfolge seine Veränderung, sein Entstehen, sei es als kompositorisches Spektrum, sei es als räumliche Dynamik....“

Diese räumliche Dynamik ist nur im Aufführungsraum selbst zu finden, zu erproben.

„Wir müssen lernen und studieren den Raum“

Luigi Nono

Auch Dieter Schnebel hat sich für sein Komposition „Studien für Klavier“ im Freiburger Studio lange mit der Funktion „Zeit und Raum unter Einbeziehung der Elektronischen Klangumformung“ beschäftigt und aus diesen Erfahrungen heraus die Form seiner Komposition gefunden. Dieter Schnebel sagte zu seiner Arbeit im Experimentalstudio:

„....Der erste Teil des Werkes heißt Raum, der zweite Zeit. Im Raumteil habe ich die elektronischen Techniken verwendet, die es mir ermöglichten, dem Klang eine räumliche Gestalt zu geben, wobei das faszinierendste Gerät das Halaphon war. Was den zeitlichen Aspekt angeht, so waren für mich im zweiten Teil zunächst verschiedene Arten von delay wichtig...“

Ich habe absichtlich keine Bilder von den Halaphon-Generationen des Experimentalstudios gezeigt. Die Entwicklung ging über analog, hybrid bis zur reinen Digitaltechnik, doch die musikalische Funktion blieb über alle Stationen erhalten. Auf die Frage, welche Bauweise mir am besten gefallen hat, habe ich nur eine Antwort: Für mich sind technische Innereien zweitrangig, entscheidend dagegen sind ihre Bedienbarkeit (Spielbarkeit), ihre technische Zuverlässigkeit, vor allem aber ihr akustisches Ergebnis, der Output.

Es folgt nun ein sehr wichtiger Nachtrag zur Klangbewegung und Phasenlage. Immer wieder kommt es im Konzert zur Kombination Klangbewegung und Original-Klang-Verstärkung. Wir müssen feststellen, dass in einem Kanal der Ton der Klangbewegung verzerrt. Es ist genau in dem Lautsprecher, über den auch eine leise Live-Verstärkung eines Instrumentes erfolgt. Grund der Störung war:

Werden zwei vollkommen gleiche Signale über einen Lautsprecher wiedergegeben, verändert sich die Amplitude, die Klangfarbe bleibt gleich. Vergleiche hierzu Seite 5. Ist nun eines der beiden Signale um einen bestimmten Betrag verzögert, dann werden bei der Zusammenmischung die Phasenlagen der einzelnen Teiltöne der beiden Klänge gegeneinander verschoben. Diese Phasenverschiebung ist für die einzelnen Teiltöne je nach der Verzögerungszeit unterschiedlich: von doppelter Lautstärke bis zur Auslöschung. Eine gering verzögerte Signalbewegung - Halaphonbewegung - und das gleiche Signal statisch auf dem gleichen Lautsprecher, verändert die Lautstärke der Klangeffekte der Phasenverschiebungen je nach Form und Geschwindigkeit der Signalbewegung. In der Synthesizer–Musik wird dieser Klangeffekt als Phasing oder auch Jet–Effekt bezeichnet. Und dies ist auch das akustische Ergebnis, wenn Klangbewegung und Live-Klang-Verstärkung auf einem Lautsprecher zusammentreffen.

Abbildung 21

Alle beschriebenen Hörereignisse sind auf Schallquellen in der Horizontalebene bezogen. Nun wird auch z. B. versucht, durch Aufhängung der Lautsprecher an der Saaldecke, oder mittels sehr hochgelegenen Sitzmöglichkeiten (Balkone) für die Interpreten, Schallquellen in die Medianebene zu verlegen. Das Richtungshören in der Medianebene unterscheidet sich jedoch wesentlich von dem in der Horizontalebene. Schalleinfall aus der Medianebene erreicht unsere Ohren nahezu gleichzeitig. Dies bedeutet, dass aufgrund von fehlenden unterschiedlichen akustischen Signalen unserem Gehörsinn keine Möglichkeit der Auswertung gegeben ist. Auf einen Nenner gebracht: je höher die Schallquelle, umso geringer ist die Lokalisie-rungsschärfe, der Klang wirkt diffuser. Schon unseren Vorfahren war dieser Hörvorgang, wenn auch mehr empirisch, bekannt. So wurden z.B. Kirchenorgeln immer möglichst hoch platziert, damit ihr Abstrahlungswinkel sehr groß war und der Klang damit relativ gut im gesamten Kirchenraum gehört wurde.

Es ist nicht Aufgabe dieses Lehrheftes, eine exakte Untersuchung über unser Hören zu veröffentlichen. Ich wollte und möchte versuchen, wichtige Forschungsergebnisse für den praktischen Musiker, ob Interpret oder Komponist, auszufiltern. So ist eine hervorragende wissenschaftliche Schrift zu diesem und dem folgenden Thema „Räumliches Hören“ von Jens Blauert8 .

Während meiner Tätigkeit im Freiburger Experimentalstudio habe ich mit meinen Studenten der Universitäten Freiburg und Basel immer wieder versucht, wissenschaftliche Experimente soweit wie möglich nachzuvollziehen. Besonders aufregend waren die Tests des Tonhöhen abhängigen räumlichen Hörens nach Jens Blauert. Mit schallabsorbierenden Wänden habe ich eine Kammer gebaut, in der zwei absolut gleiche Lautsprecher, gegeneinander gerichtet, standen. Auf deren Längsachse saß nun die Versuchsperson, den Blick auf einen der beiden Lautsprecher gerichtet und zu beiden Lautsprechern der gleiche Abstand. Die Testperson musste nun auf einer vorgefertigten Tabelle nur ankreuzen, aus welcher Richtung sie die Töne hörte: v = vorne, h = hinten und o = oben. Eingespielt wurden verschiedene Tonimpulse oder schmalbandiges Rauschen mit verschiedenen Tonhöhen und unterschiedlicher Dynamik. Achzig Prozent der Versuchspersonen stimmte mit denen von Blauert geführten Versuchen überein: In einem Bereich um 500 Hz wurde das Signal vorne, um 1000 Hz von hinten, um 4000 Hz wieder von vorne, 8000 Hz von oben und ca. 12000 Hz wieder von hinten geortet, obwohl alle Tonhöhen einmal von vorne und einmal von hinten eingespielt wurden.

Hierzu zwei Beispiele aus Konzerträumen:

Anlässlich eines Konzerts in der Kirche des Freiburger Augustiner Museums hat die Stuttgarter Schola Cantorum unter Leitung von Clytus Gottwald eine Chorkom-position des Spaniers Tomas Marco aufgeführt. Der Anfang des Werkes war so konzipiert, dass mit dem zweiten Bass beginnend die Stimmen nacheinander in unterschiedlichen Tonhöhen einsetzten. Als der Klang der Frauenstimmen metallischer wurde und den Höhenbereich von C3 erreichte, wanderte ein Teil des von vorne gehörten Chorklanges gegen die Rückseite des Konzertraumes, er wurde räumlicher.

Noch gravierender in Beziehung Tonhöhen bezogenes Richtungshören war die erste akustische Probe für die Uraufführung von Nonos „Camminantes“ in München-Gasteig. Auf Wunsch des Komponisten führte Herr Schlotter, Organist an Gasteig, die große Konzertorgel vor. Nono hörte sich vor allem die tiefen (32-Fuß) und hohen (2- und 1-Fuß) Register an. Als Herr Schlotter ein 2-Fuß Oktavino vorspielte, bat ihn Nono mit diesem Register den Ton h3 zu spielen. Plötzlich war der Ton nicht mehr von vorne, also von der Orgel her zu hören, sondern von der Mitte des Saales, quasi aus der Decke zu hören. h3 im 2-Fuß Register gespielt hat die Tonhöhe 7902 Hz und liegt damit im Bereich von 8000 Hz. Nono war von diesem akustischen Phänomen so begeistert , dass er später in seiner Komposition h3. Oktavino 2-Fuß und Hohlflöte 2-Fuß immer wieder für sehr lang ausgehaltene Orgeltöne einsetzte. Er verarbeitete das Tonhöhen bezogene Richtungshören in „Camminantes“ als Teilfunktion seiner sehr auf das räumliche Hören bezogenen Komposition.

Es folgen ein paar Worte zur Positionierung der Lautsprecher im Konzertraum. Leider sind unsere heutigen Konzertsäle meist sehr lautsprecherfeindlich. Es fehlen die notwendigen Aufhängungsvorrichtungen wie z. B. Seilzüge an verschiedenen Positionen der Saaldecke. Es wäre schön, wenn die Architekten bei ihrer Planung auch an die Aufführung von Kompositionen mit modernen Klangkörpern wie Live-Elektronik denken würden. In den meisten Räumen sind wir auf die Aufstellung von Stativen angewiesen, und selbst dies macht immer wieder aus Sicherheits- und auch Schönheitsgründen Schwierigkeiten. Auf jeden Fall müssen wir Lautsprecheraufhängungen auf den Stativen verwenden, die kugelförmig gedreht werden können, um möglichst ein differenziertes Klangbild zu erhalten. In Abbildung 22 sehen wir eine einfache Aufhängung, die um zwei Achsen gedreht werden kann.

Abbildung 22

Denken wir an die zuvor genannten Klangwege, so ist nicht die Abstrahlrichtung des Lautsprechers zum Saal hin immer zweckmäßig. Gerade bei Klängen, die der Zuhörer außerhalb der Saalgrenzen wahrnehmen soll, kann ein Lautsprecher auch zur Wand oder nach oben gedreht das Klangergebnis verbessern. Wunderbar für den Klangabgleich sind z. B. Räume wie die der Frankfurter Alten Oper. Dort stehen neben einzelnen Seilzügen auch Querstangen zur Verfügung, die aus der Decke heruntergelassen werden. Das Experimentalstudio der Heinrich-Strobel-Stiftung besitzt hierfür spezielle Aufhängungsvorrichtungen, siehe Abbildung 23.

Abbildung 23

Diese Halterung ist vor allem für größere Lautsprecher zugelassen. Der Lautsprecher kann im Bedarfsfall auch zusätzlich mit Perlondrähten abgespannt werden. Ebenfalls ist eine Aufhängung an einer Querstange direkt möglich. Abbildung 24 zeigt zwei Lautsprecher an einer Querstange über der Vorderbühne der Frankfurter Alten Oper. Für die akustische Einrichtung eines Klangraumes können die Lautsprecher herabgelassen und ihre Abstrahlungsrichtung immer verändert werden.

Abbildung 24

Die Lautsprecher werden an der Stange verschraubt und danach ausgerichtet. Diese Arbeit kann auch von Nichttechnikern „mühelos“ ausgeführt werden, siehe Abbildung 24, Studioleiter Andrè Richard bei der Befestigung. Eine andere Möglichkeit ist diese Aufhängung an einem mit kleinerer Einzelstange ausgestatteten Seilzug. Diese Vorrichtung bietet eine noch bessere Möglichkeit der seitlichen Abspannung und kann besonders empfohlen werden. Die nächste Abbildung zeigt zwei Lautsprecher mit zwei dieser Aufhängungen über der Vorderbühne der Alten Oper in Frankfurt.

Abbildung 25

Soweit wenige Gedanken zu den Problemen der Lautsprecheraufhängung.

Und wenn alle technischen Einrichtungen vorhanden sind, ist eine gute Vorbereitung unter Einbeziehung der räumlichen Verhältnisse des Aufführungsortes wichtig. Dies bedeutet, dass von Beginn der Planung einer akustischen Einrichtung für ein Konzert, rechtzeitig die räumliche Situation gekannt werden muss. Dies schließt auch die Erfassung der technischen Hilfen seitens der Saaltechnik und Auf- und Umbauten durch den Veranstalter ein. Voraussetzung für diese Vorbereitungen ist die Kenntnis der vom Komponisten in der Partitur vorgeschriebenen technischen Details, der technischen Legende. Nun ist es immer schwierig, diese technische Legende des Komponisten richtig zu lesen und zu verstehen. Ich denke z. B. an die eigene Aus- und Mitarbeit an Legenden für einen Teil von Nonos, Schnebels oder Halffters Werken. Alle technischen Aufzeichnungen sind meist Prinzipschaltbilder. Dazu gehören vor allem die Angaben über Lautsprecherpositionen. Diese Informationen sind einmal Voraussetzung unserer persönlichen Planung, gleichzeitig aber auch abhängig von den gegebenen räumlichen Möglichkeiten am Aufführungsort. Und dies ist das größte Problem, Kompromisse zwischen vorgeschriebenen technischen Wünschen des Komponisten (technische Legende in der Partitur) und der technischen Situation im Konzertsaal zu finden. Wunschdenken und Realität widersprechen sich leider immer wieder. Die Diskussion über eine werkgetreue Interpretation erhält dadurch immer neue Anstöße und erschwert unnötig die Arbeit.

Kompromisse sind und bleiben der einzige Ausweg. Es ist jedoch dafür von großer Bedeutung, dass Entscheidungen nicht nur von technischer, sondern primär auch von musikalischer Seite getroffen werden müssen, denn hierfür ist unbedingt die Kenntnis musikalischer Kriterien einer Komposition notwendig. Diese Kenntnis ist nicht immer nur aus der Partitur, sondern auch z. B. durch mündliche und schriftliche Berichte, Besuche anderer Aufführungsorte des Werkes oder Abhören von schon vorhandenen Tonträgern zu erlangen.

Nun hatte ich das Glück, mit vielen Komponisten noch persönlich zusammenzuarbeiten. Und gerade die gemeinsam durchgeführten Konzerte mit Luigi Nono oder Dieter Schnebel haben mich darin bestärkt, dass innerhalb des zuvor beschriebenen „Kompromisses“ seitens der Komponisten uns Interpreten - und dazu zähle ich auch die Technik - eine relativ große Freiheit zugestanden wurde. Ich erinnere nochmals an die Bemerkung Nonos: „Es gibt keine schlechten Konzertsäle“. Wir müssen uns nur die Zeit nehmen, sie richtig zu studieren und daraus ein qualitatives Maximum für die Aufführung einer Komposition zu finden. Ein Beispiel aus der Praxis. Für die Aufführung von Nonos Prometeo sind zwei Fernlautsprecher außerhalb des Konzertsaales vom Komponisten vorgeschrieben. Leider war dies bei einigen Aufführungen aus baulichen Gründen nicht möglich. Der Komponist war sofort damit einverstanden, dass wir diese beiden Lautsprecher auf einer Empore zur Wand gedreht postierten und durch ein zusätzliches elektronisches Echo den von ihm gewünschten „Fernklang“ nachbildeten.

Zum Abschluss meines Textes zeige ich einige Entwürfe für die räumliche Gestaltung von Nonos Prometeo an verschiedenen Aufführungsorten:

Abbildung 26

Uraufführung in S. Lorenzo, Venezia, Spazio musicale von Renzo Piano.

Abbildung 27

Uraufführung der zweiten und endgültigen Fassung in Milano, Spazio musicale von Renzo Piano in einer Werkshalle der Firma Ansaldo. Die Abbildung ist der von oben gesehene Raum mit aufgeklappten Wänden (Zeichnung Alvise Vidolin).

Abbildung 28

Aufführung im Theatre National de Chaillot, Paris. Grand Théâtre ohne große Umbauten. Für die Höhenstaffelung wurden vor allem Beleuchterbühnen und -gänge verwendet.

Abbildung 29

Alte Oper Frankfurt, Plan des leeren Raumes.

Abbildung 30

Abbildung 30 (=20), endgültiger Entwurf.

1 Christian Doppler, 1803-1853, Österreichischer Physiker

2 J. Meyer in Michael M. Rieländer, Reallexikon der Akustik. Frankfurt a. M.: Verlag E. Bochinsky, 1982, S. 24

3 Jens Blauert, Räumliches Hören, Stuttgart: S. Hirzel Verlag, 1974, S. 9

4 Michael M. Rieländer, Reallexikon der Akustik, Frankfurt a. M.: Verlag E. Bochinsky,1982, S. 254 ff.

5 vgl. H. P. Haller, Das Experimentalstudio der Heinrich-Strobel-Stiftung des Südwestfunks Freiburg 1971- 1989, Baden-Baden, Nomos Verlagsgesellschaft, 1995, Bd. 1, S. 144 ff.

6 Michael M. Rieländer, Reallexikon der Akustik, Frankfurt a. M.: Verlag E. Bochinsky, 1982, S.233 ff.

7 Jens Blauert, Räumliches Hören, Stuttgart: S. Hirzel Verlag, 1974.